В статье «Сбалансированная денежная единица и многосторонний клиринг» я описывал модель международных расчетов, построенную на клиринге и СДЕ — сбалансированной денежной единице.

Здесь я попробую численно смоделировать экономику отдельно взятого государства, участвующего с такой системе.

Начну с описания численной модели.

Пусть в экономике страны участвуют 20 независимых субъектов.

Каждый производит некий абстрактный продукт — на сумму 100 СДЕ в единицу времени.

Задана начальная сумма денег у каждого субъекта.

Будем проводить три испытания — с начальными суммами соответственно 50, 100 и 150 единиц национальной валюты.

Начальный курс СДЕ к национальной валюте положим равным 1.

В каждую единицу времени каждый субъект может продать от 0 до 15 процентов (случайное число) продукта за границу и заработать на этом денег.

Остальной продукт потребляется.

Так же субъект может потратить от 0 до 15 процентов (случайное число) своих денег на приобретение импортных товаров.

Начальный баланс страны в клиринговой системе равен нулю.

Рассмотрим три случая:

1. Курс СДЕ фиксирован.

2. Между клиринговым балансом страны и курсом СДЕ существует обратная связь, не зависимая от времени.

3. Зависимая от времени обратная связь.

Результаты численного моделирования под катом.

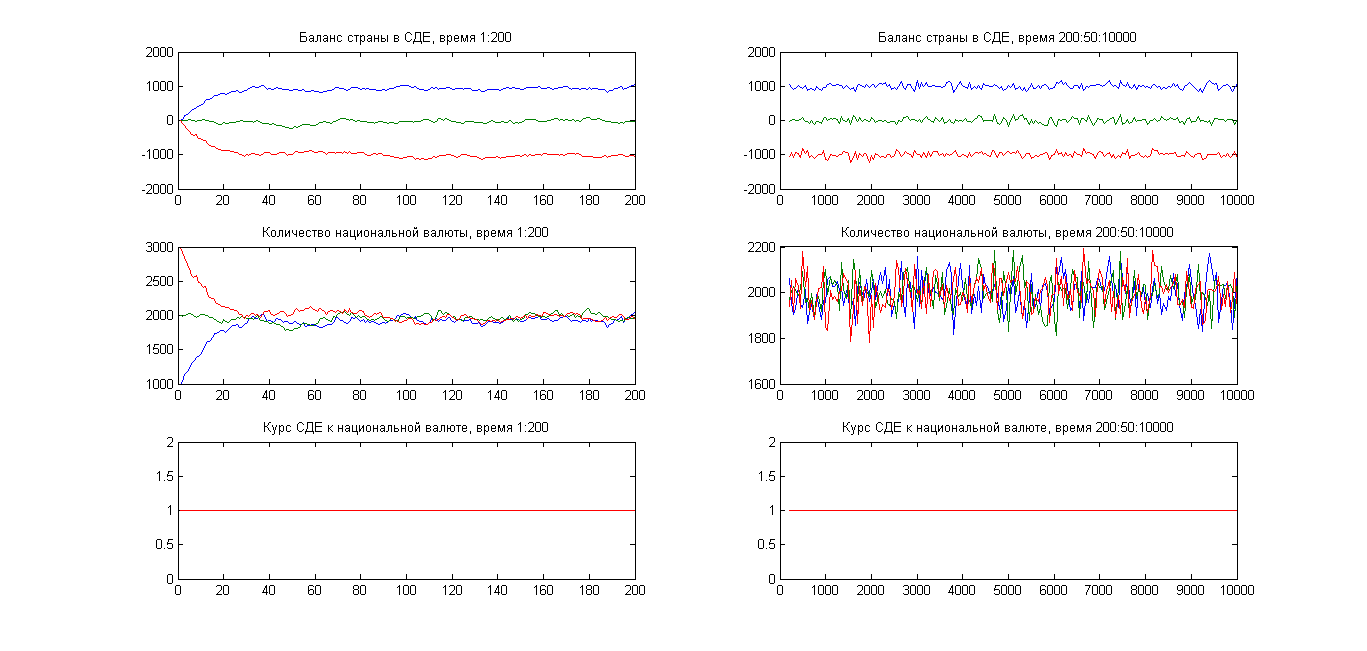

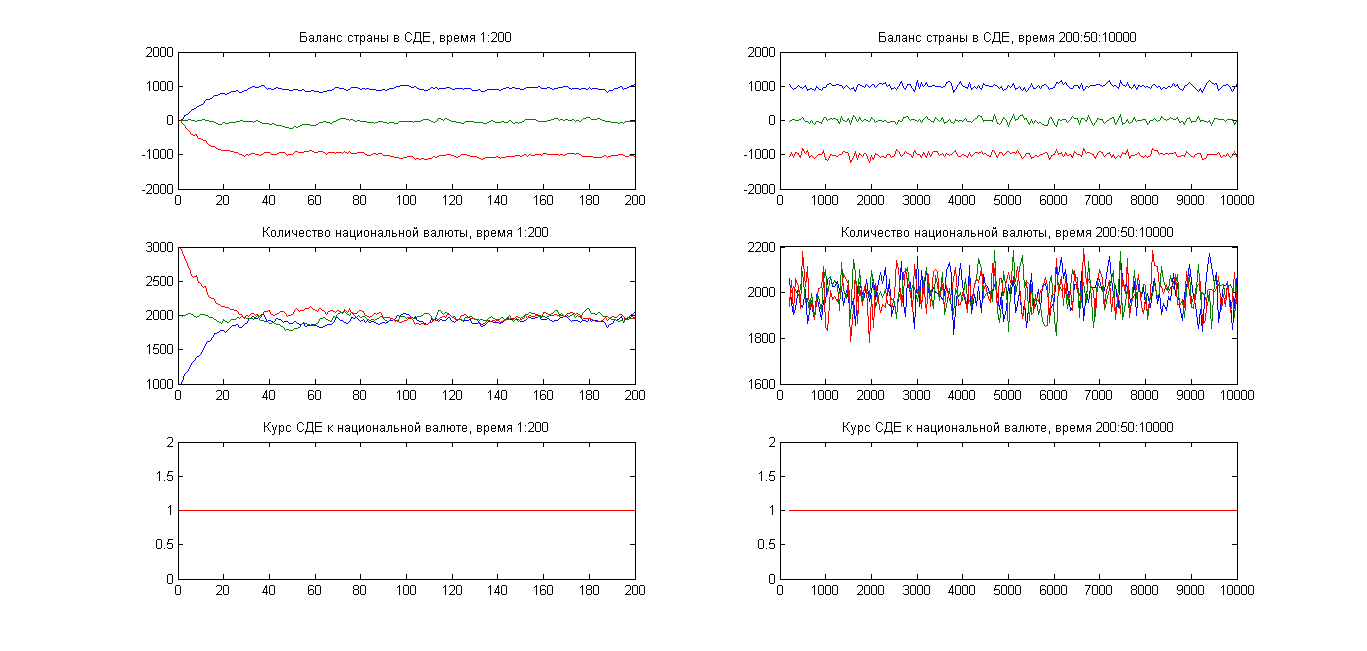

Фиксированный курс СДЕ.

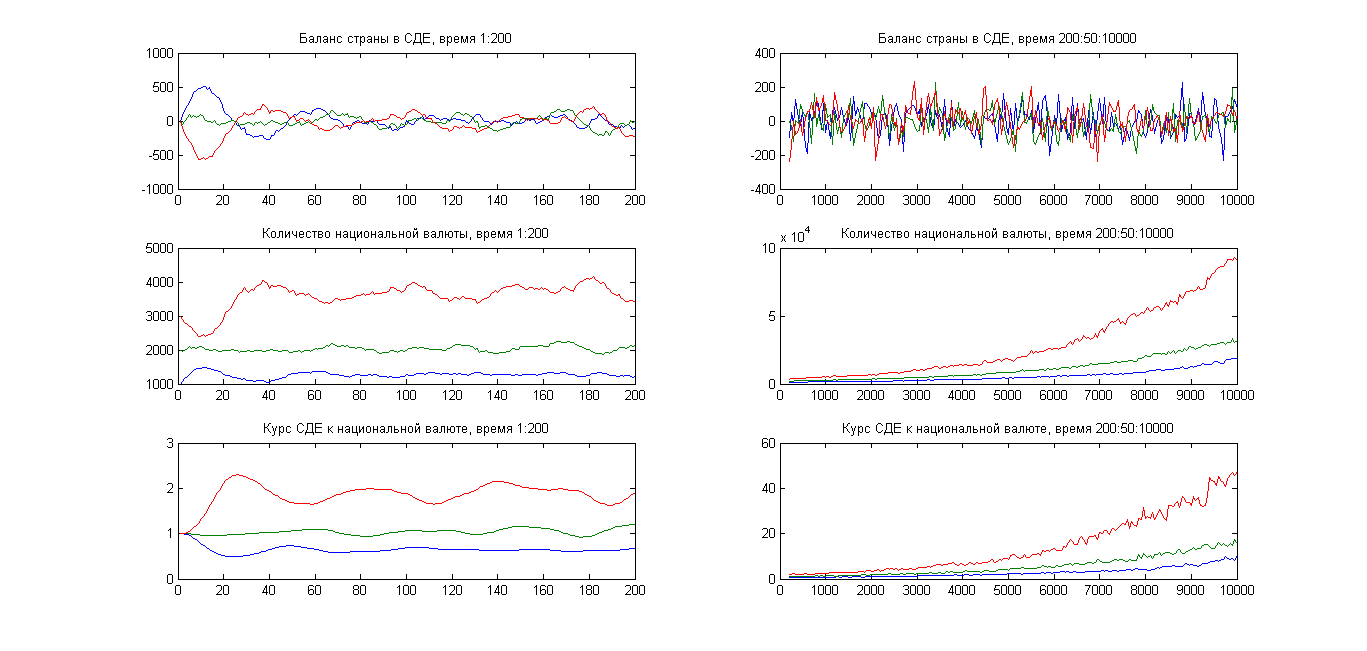

Результаты на графиках ниже.

На графиках слева — время от 1 до 200, на графиках справа — от 200 до 10000.

Видно, что если начальный объем денежной массы слишком велик, он постепенно падает до равновесного значения, и, соответственно, возрастает, если изначально он слишком мал.

Клиринговый баланс страны уходит, соответственно, в минус или в плюс, и стабилизируется на некотором значении.

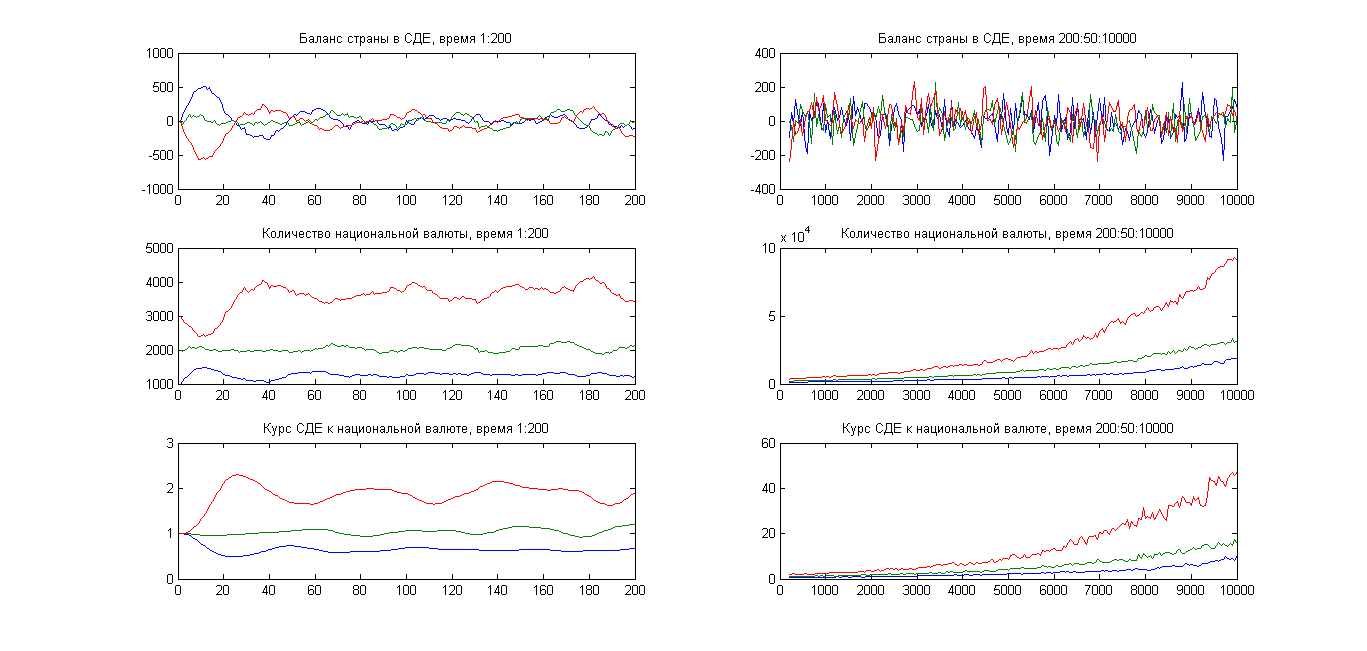

Обратная связь, не зависимая от времени.

Используется следующая обратная связь:

Результаты следующие:

Как видим, клиринговый баланс страны постепенно выходит на колебания вокруг нуля.

Но при этом наблюдается постоянный рост денежной массы и рост курса СДЕ, другими словами — инфляция.

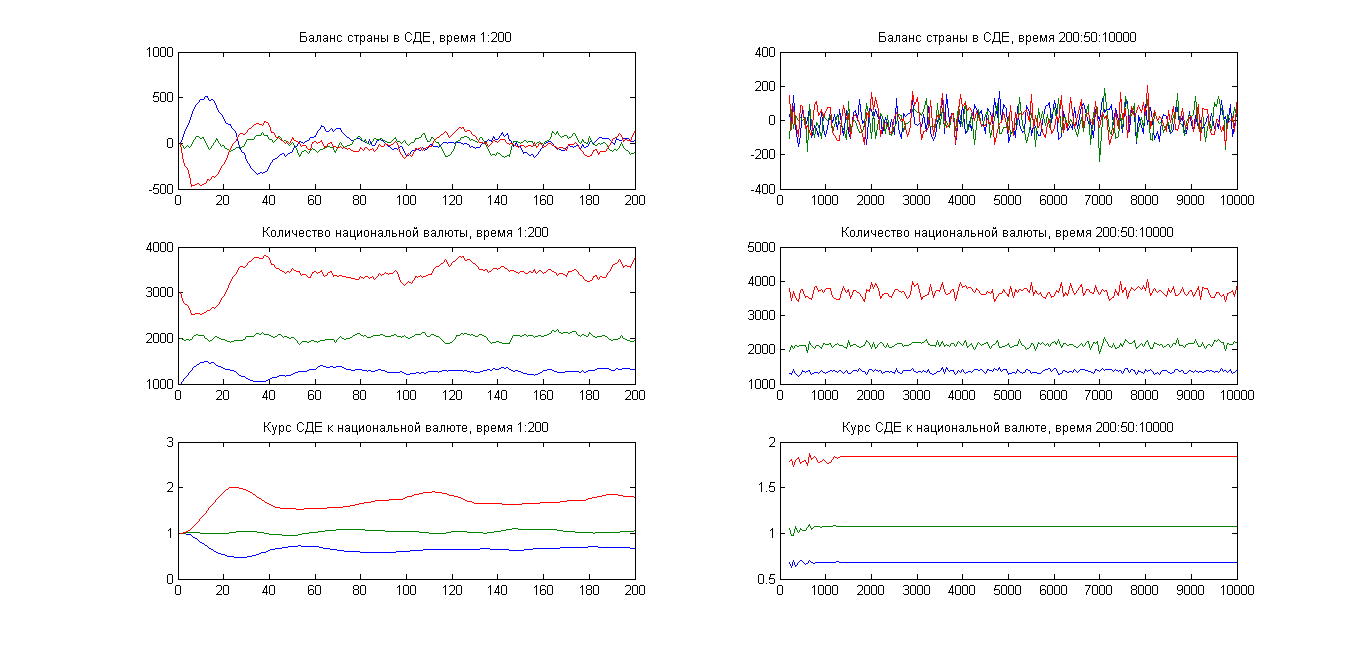

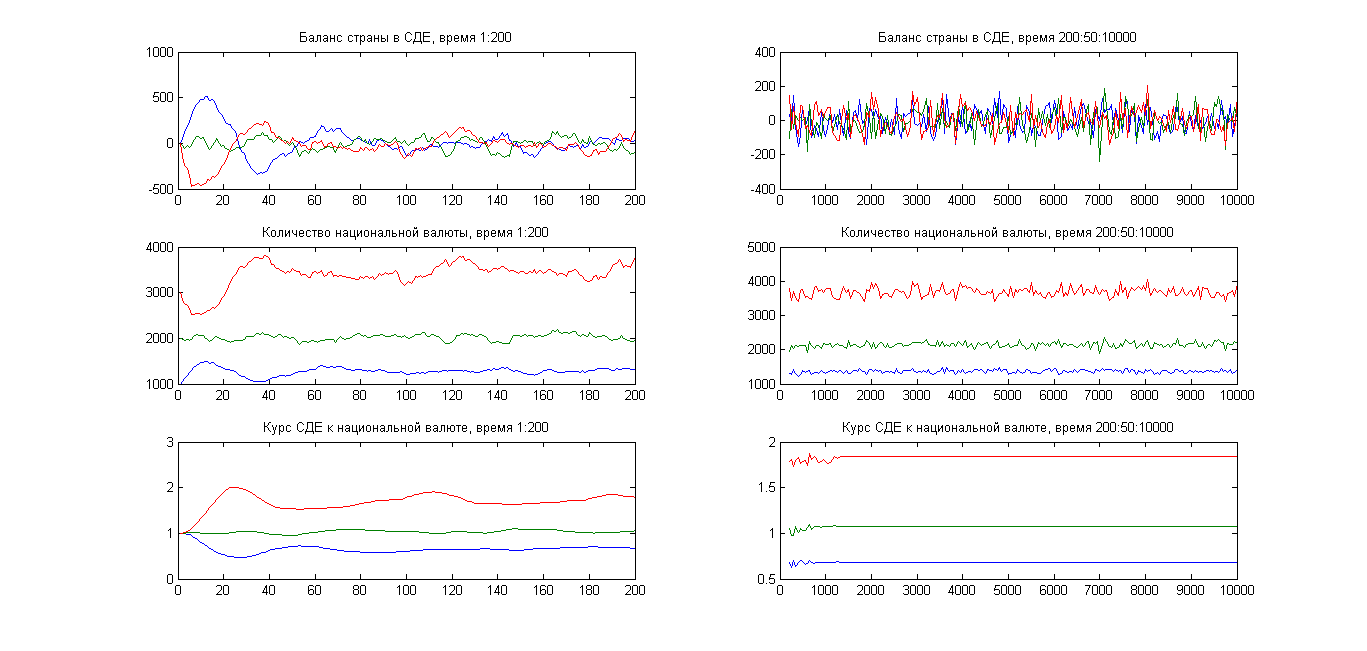

Зависимая от времени обратная связь (управление).

Обратная связь следующая:

То есть, со временем она постепенно ослабевает.

Результат:

Как видим, объем денежной массы и курс СДЕ со временем стабилизируются.

При этом клиринговый баланс страны колеблется около нуля.

То есть в системе возникает динамическое равновесие.

Скрипты здесь: github.com/tabatsky/jatx/tree/master/BMU

Здесь я попробую численно смоделировать экономику отдельно взятого государства, участвующего с такой системе.

Начну с описания численной модели.

Пусть в экономике страны участвуют 20 независимых субъектов.

Каждый производит некий абстрактный продукт — на сумму 100 СДЕ в единицу времени.

Задана начальная сумма денег у каждого субъекта.

Будем проводить три испытания — с начальными суммами соответственно 50, 100 и 150 единиц национальной валюты.

Начальный курс СДЕ к национальной валюте положим равным 1.

В каждую единицу времени каждый субъект может продать от 0 до 15 процентов (случайное число) продукта за границу и заработать на этом денег.

Остальной продукт потребляется.

Так же субъект может потратить от 0 до 15 процентов (случайное число) своих денег на приобретение импортных товаров.

Начальный баланс страны в клиринговой системе равен нулю.

Рассмотрим три случая:

1. Курс СДЕ фиксирован.

2. Между клиринговым балансом страны и курсом СДЕ существует обратная связь, не зависимая от времени.

3. Зависимая от времени обратная связь.

Результаты численного моделирования под катом.

Фиксированный курс СДЕ.

Результаты на графиках ниже.

На графиках слева — время от 1 до 200, на графиках справа — от 200 до 10000.

Видно, что если начальный объем денежной массы слишком велик, он постепенно падает до равновесного значения, и, соответственно, возрастает, если изначально он слишком мал.

Клиринговый баланс страны уходит, соответственно, в минус или в плюс, и стабилизируется на некотором значении.

Обратная связь, не зависимая от времени.

Используется следующая обратная связь:

BMU_course(t) = BMU_course(t-1)*BMU_feedback(BMU_balance(t-1),t);

%%%%%%%%

function [feedback] = BMU_feedback(BMU_balance, t)

q1 = 0.0001;

feedback = exp(-q1*BMU_balance);

end

Результаты следующие:

Как видим, клиринговый баланс страны постепенно выходит на колебания вокруг нуля.

Но при этом наблюдается постоянный рост денежной массы и рост курса СДЕ, другими словами — инфляция.

Зависимая от времени обратная связь (управление).

Обратная связь следующая:

function [feedback] = BMU_feedback(BMU_balance, t)

q1 = 0.0001;

q2 = 0.003;

feedback = exp(-q1*BMU_balance)^exp(-q2*t);

end

То есть, со временем она постепенно ослабевает.

Результат:

Как видим, объем денежной массы и курс СДЕ со временем стабилизируются.

При этом клиринговый баланс страны колеблется около нуля.

То есть в системе возникает динамическое равновесие.

Скрипты здесь: github.com/tabatsky/jatx/tree/master/BMU