Привет, Хабр!

Недавно я публиковал пост о конструкторе Хватоход. Сейчас идет подготовка к обучению людей разного возраста конструированию и электронике, в нашем коворкинг-центре. Для этого так же необходимо подобрать оборудование.

Согласно поставленной руководством задаче, оборудование для конструирования должно отвечать следующим требованиям:

— стоимость не более 30 тысяч рублей

— открытая архитектура (программная и аппаратная)

— простота в обслуживании и доступность деталей

— безопасность эксплуатации

— возможность изготовления на нем сложных изделий

— быстрая окупаемость

Ранее у меня был опыт работы в сфере 3D-печати более 1,5 лет. Поэтому выбор был сделан в пользу 3D-принтера.

Для занятий конструированием и электроникой был выбран набор для самостоятельной сборки DIY(Do It Yorself), 3D-принтер MC5 от МастерКит, созданный на базе одного из российских производителей 3D-принтеров:

Набор для сборки, создан для того чтобы егопродать собрать и обучать. Он будет использоваться для создания деталей самого себя (RepRap концепция), вспомогательного оборудования и обучения электроники.

Количество выпитого кофе можете подсчитать в таймлапсе процесса сборки, который занял всего 12 часов:

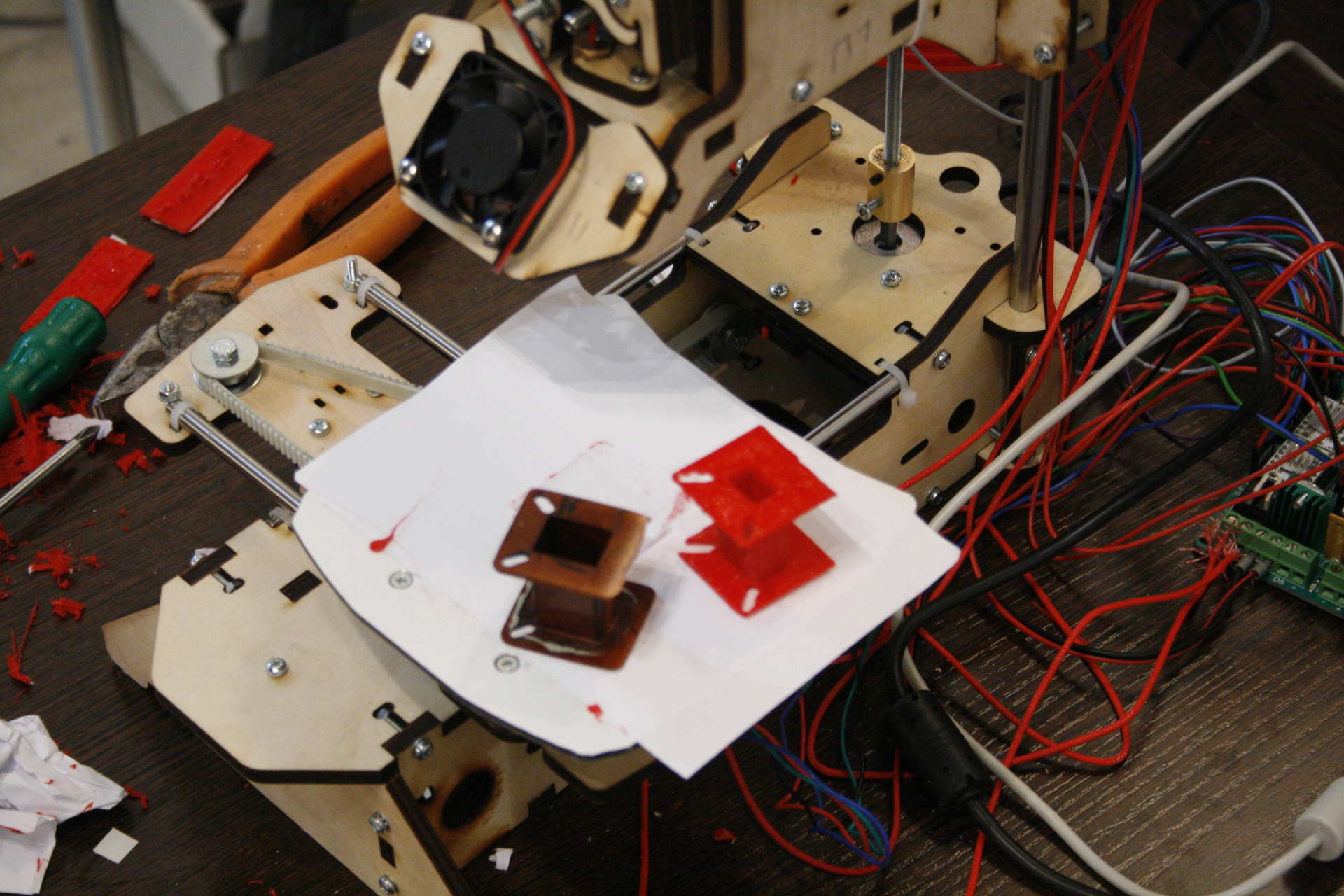

Весь процесс достаточно тривиален, если вес отвертки в руке вас не пугает. Имеется вполне понятная, русскоязычная инструкция. Перед началом процесса сборки, детали из фанеры лучше пометить карандашом для удобства восприятия:

Линейные подшипники рекомендую сразу надеть на оси, чтобы избежать несоосности, потери шариков и нервов:

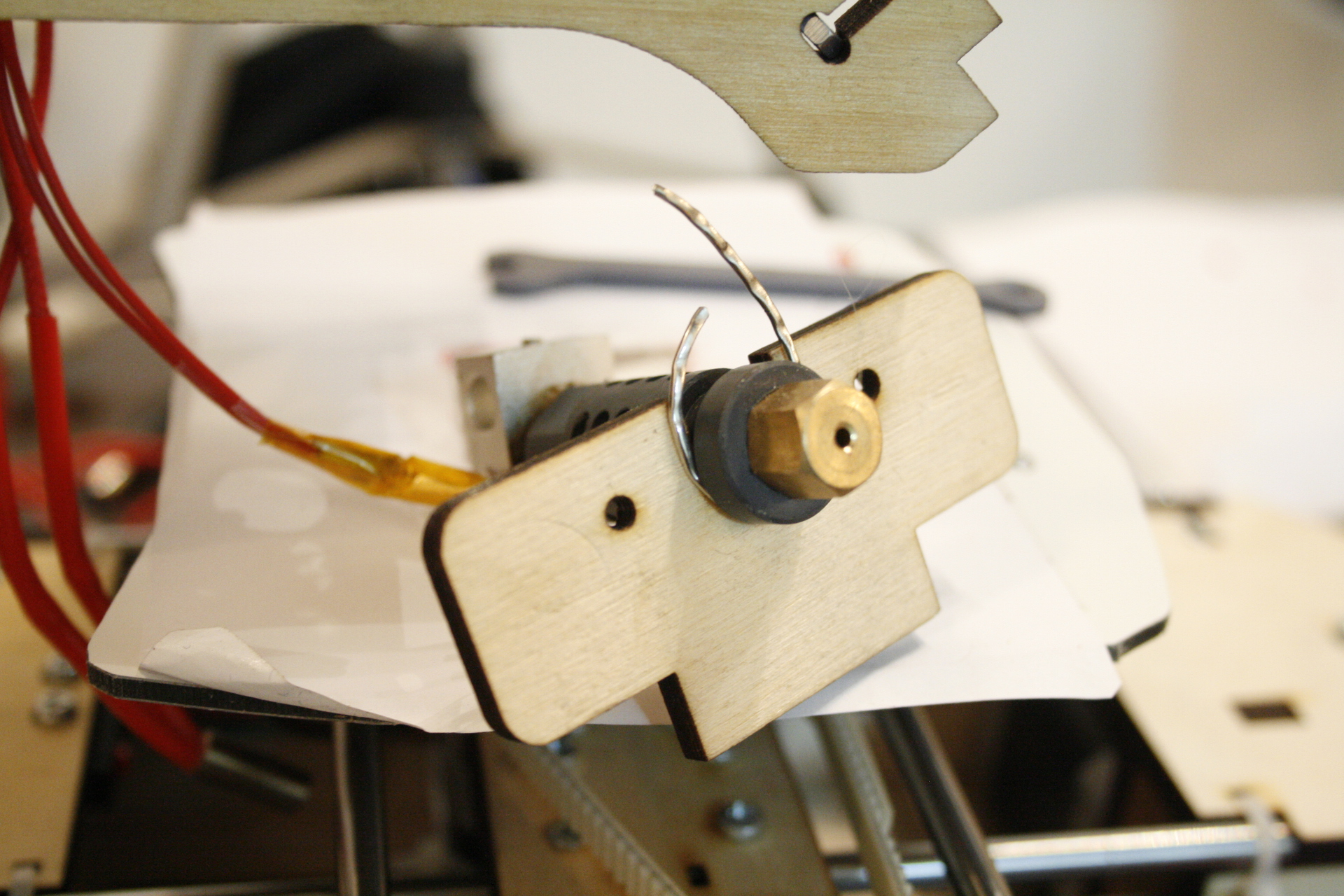

При сборке узла печатающей головки в присоединении экструдера J-Head к корпусу, встретился спорный момент. В инструкции необходимо подложить шайбу М8, перепробовал разные варианты, но головка J-Head таки болталась:

Печатающая головка J-Head:

Временное решение было найдено при помощи кольца от лазерной указки, которую подложил вместо указанной шайбы:

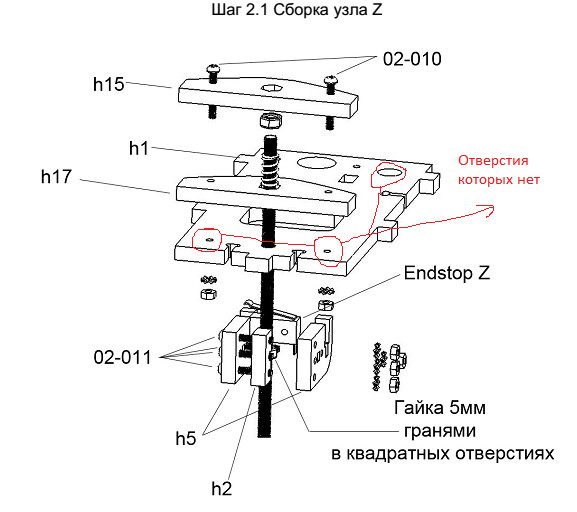

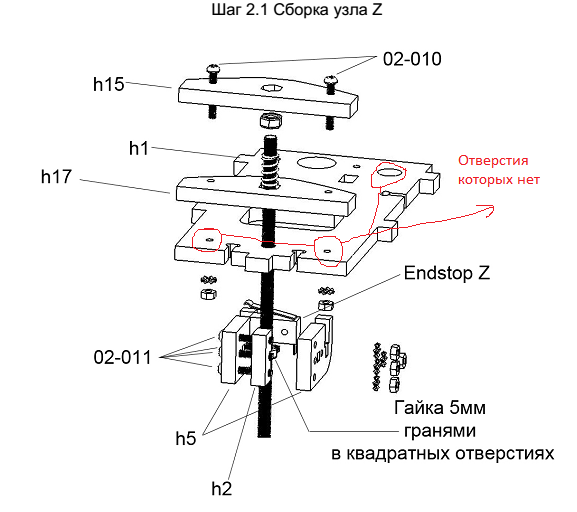

Так же, мне не удалось обнаружить указанных отверстий в деталях для фиксации гайки на шпильке вертикальной оси Z и для проводов от печатающей головки:

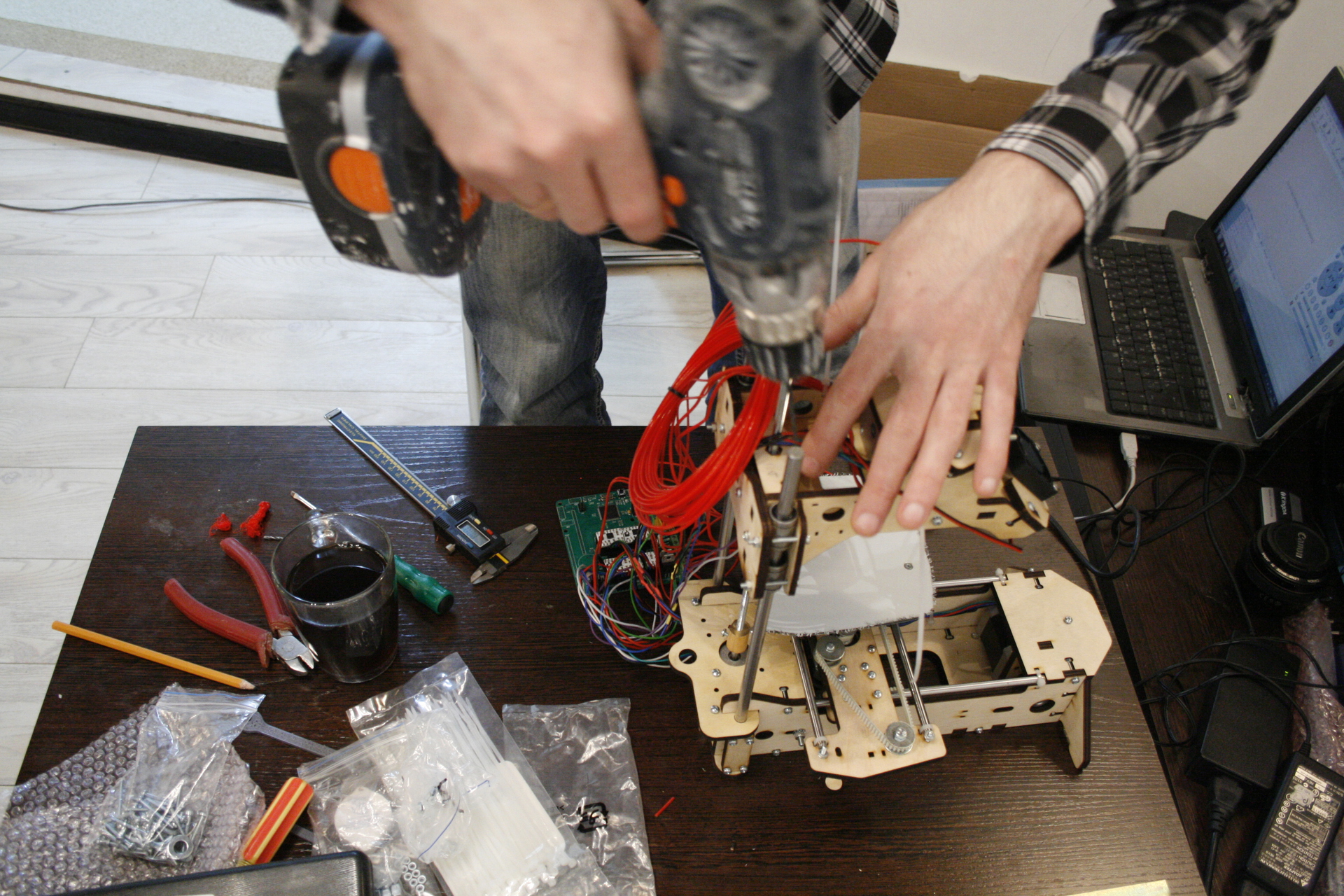

Но процесс не остановить. При помощилазера дрели и сверл на 3 мм и 8 мм, легко проделаны отсутствующие 3 отверстия:

Далее остается подтянуть ремни наживотах осях XY и можно подключать электронику.

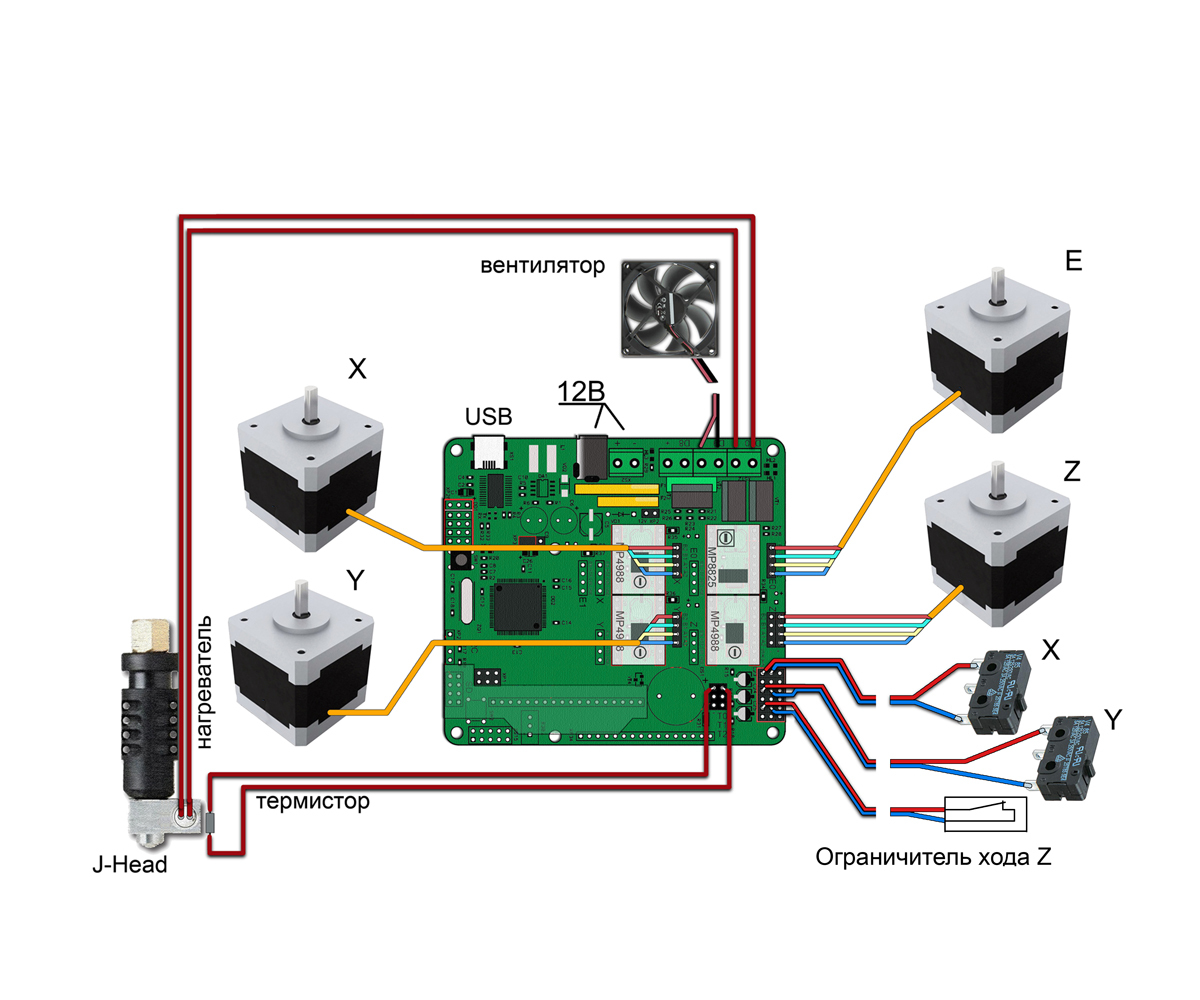

Все провода и контакты имеют обозначения. Открываем схему и втыкаем куда показано:

Обратите внимание на драйвер двигателя экструдера. У меня все 4 драйвера были А4988 (MP4988), поэтому они должны быть ориентированы подстроечным резистором в одном направлении, как показано на схеме. Резисторы крутить не надо.

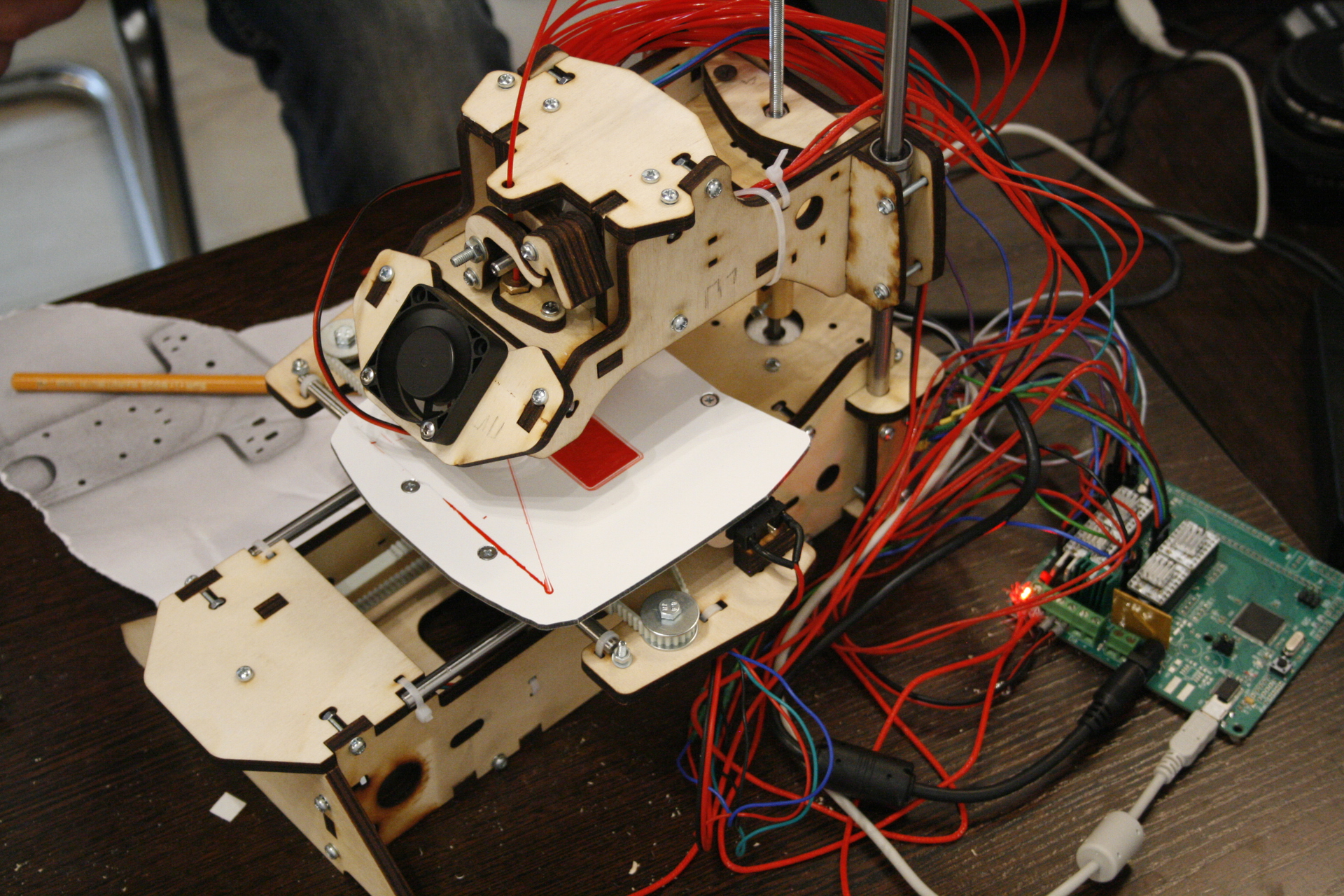

Вид собранного 3D принтера:

Провода прятать и крепить сразу — не советую. Потерпите немного.

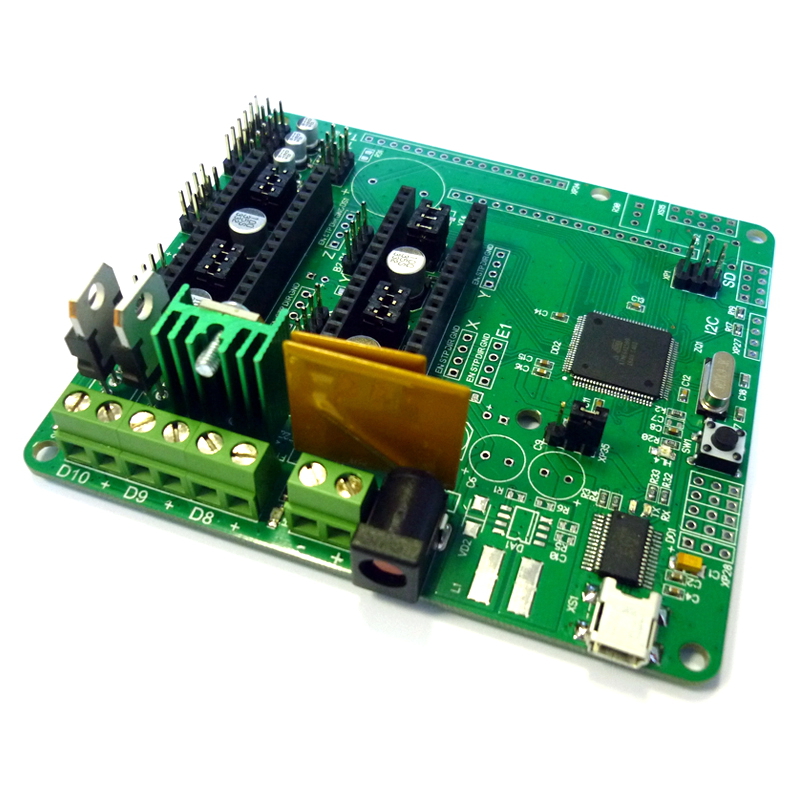

Плата управления использует открытую аппаратную и программную архитектуру: Mastertronics (именно она была в комплекте) это гибрид Arduino MEGA 2560 и шилда для 3D-принтеров Ramps 1.4:

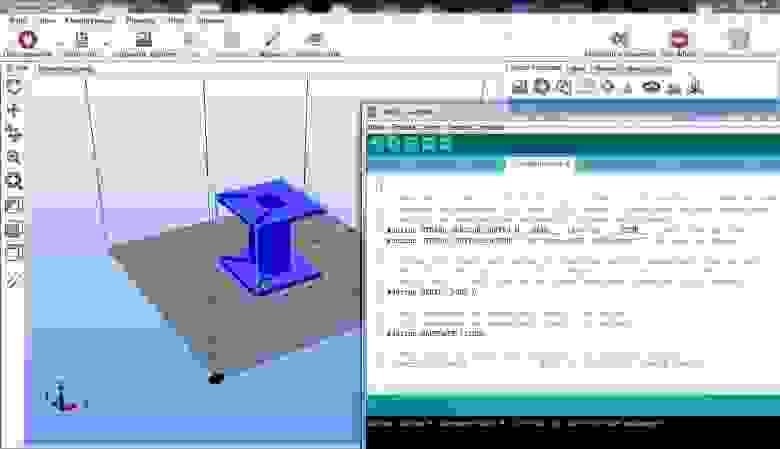

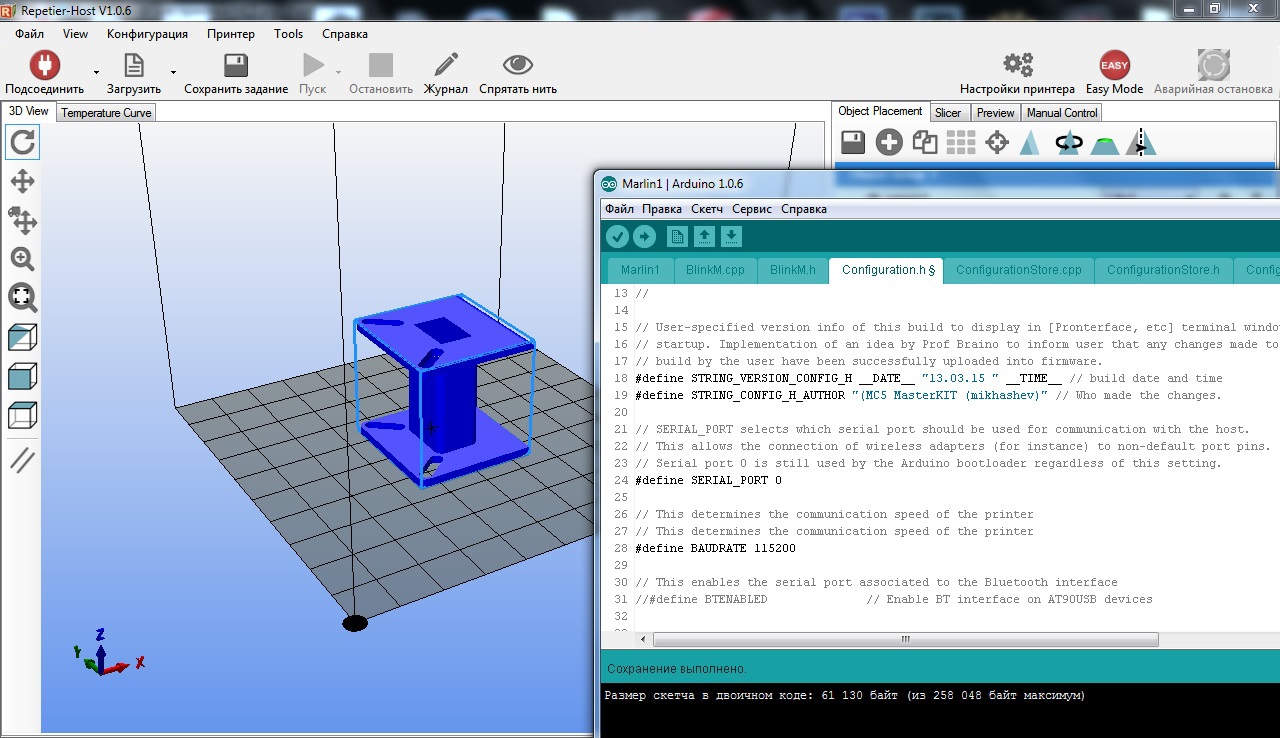

Поэтому смело качаемopen source бесплатный софт: Repetier-host (для связи ПК с платой управления 3D-принтером) и Arduino IDE (Для допиливания кода прошивки микроконтроллера). О тонкостях настройки этого программного обеспечения будет рассказано во второй части:

После настройки софта можно будет печатать:

Специально для хабра Мастер Кит предоставил промо-код HABR, который дает скидку 7% на любой заказ на сайте 3d.masterkit.ru

Недавно я публиковал пост о конструкторе Хватоход. Сейчас идет подготовка к обучению людей разного возраста конструированию и электронике, в нашем коворкинг-центре. Для этого так же необходимо подобрать оборудование.

Согласно поставленной руководством задаче, оборудование для конструирования должно отвечать следующим требованиям:

— стоимость не более 30 тысяч рублей

— открытая архитектура (программная и аппаратная)

— простота в обслуживании и доступность деталей

— безопасность эксплуатации

— возможность изготовления на нем сложных изделий

— быстрая окупаемость

Ранее у меня был опыт работы в сфере 3D-печати более 1,5 лет. Поэтому выбор был сделан в пользу 3D-принтера.

Для занятий конструированием и электроникой был выбран набор для самостоятельной сборки DIY(Do It Yorself), 3D-принтер MC5 от МастерКит, созданный на базе одного из российских производителей 3D-принтеров:

Набор для сборки, создан для того чтобы его

Количество выпитого кофе можете подсчитать в таймлапсе процесса сборки, который занял всего 12 часов:

Весь процесс достаточно тривиален, если вес отвертки в руке вас не пугает. Имеется вполне понятная, русскоязычная инструкция. Перед началом процесса сборки, детали из фанеры лучше пометить карандашом для удобства восприятия:

Линейные подшипники рекомендую сразу надеть на оси, чтобы избежать несоосности, потери шариков и нервов:

При сборке узла печатающей головки в присоединении экструдера J-Head к корпусу, встретился спорный момент. В инструкции необходимо подложить шайбу М8, перепробовал разные варианты, но головка J-Head таки болталась:

Печатающая головка J-Head:

Временное решение было найдено при помощи кольца от лазерной указки, которую подложил вместо указанной шайбы:

Так же, мне не удалось обнаружить указанных отверстий в деталях для фиксации гайки на шпильке вертикальной оси Z и для проводов от печатающей головки:

Но процесс не остановить. При помощи

Далее остается подтянуть ремни на

Все провода и контакты имеют обозначения. Открываем схему и втыкаем куда показано:

Обратите внимание на драйвер двигателя экструдера. У меня все 4 драйвера были А4988 (MP4988), поэтому они должны быть ориентированы подстроечным резистором в одном направлении, как показано на схеме. Резисторы крутить не надо.

Вид собранного 3D принтера:

Провода прятать и крепить сразу — не советую. Потерпите немного.

Плата управления использует открытую аппаратную и программную архитектуру: Mastertronics (именно она была в комплекте) это гибрид Arduino MEGA 2560 и шилда для 3D-принтеров Ramps 1.4:

Поэтому смело качаем

После настройки софта можно будет печатать:

Специально для хабра Мастер Кит предоставил промо-код HABR, который дает скидку 7% на любой заказ на сайте 3d.masterkit.ru

Только зарегистрированные пользователи могут участвовать в опросе. Войдите, пожалуйста.

DIY или BUY?

81% DIY584

19% BUY137

Проголосовал 721 пользователь. Воздержались 144 пользователя.